A Inteligência Artificial (IA) está se tornando cada vez mais presente na vida dos jovens, mas, conforme um recente caso na Flórida, essa inovação traz riscos significativos à saúde mental. Uma mãe está processando a Character.AI após o suicídio de seu filho, alegando que interações inadequadas com chatbots contribuíram para a tragédia.

Estudos já mostram uma relação preocupante entre o uso excessivo de tecnologias digitais e o aumento de problemas de saúde mental em adolescentes. Um relatório da American Psychological Association destacou que jovens que passam mais tempo em redes sociais e ambientes digitais interativos, como chatbots, apresentam maior risco de desenvolver ansiedade e depressão.

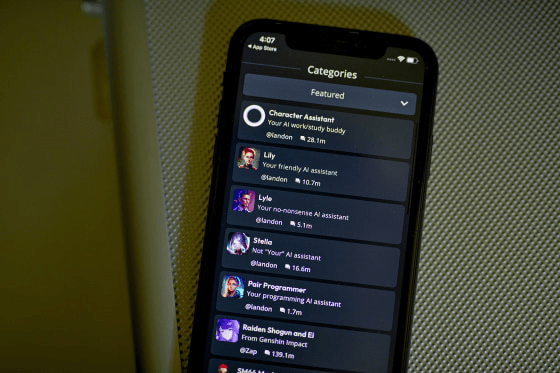

Medidas de segurança da Character.AI – são suficientes?

A Character.AI, após a tragédia, anunciou a implementação de medidas de segurança, como pop-ups de alerta para termos de autoagressão. No entanto, a eficácia dessas medidas é questionável. Embora direcionar os usuários para linhas de apoio seja importante, especialistas defendem que mudanças estruturais são necessárias para proteger de maneira mais eficaz o público jovem, incluindo algoritmos que filtrem proativamente conteúdos nocivos e detectem comportamentos de risco.

Como os pais podem monitorar o uso da IA

Para os pais, manter-se informado sobre como as tecnologias de IA estão sendo usadas pelos filhos é essencial. Aqui estão algumas sugestões práticas:

- Estabeleça limites de tempo: Limitar o tempo de uso de dispositivos e aplicações que utilizam IA pode ajudar a reduzir a exposição excessiva.

- Converse sobre o conteúdo: Incentive discussões abertas com seus filhos sobre as interações que estão tendo online, questionando sobre os bots e a natureza dessas conversas.

- Use controles parentais: Aproveite as ferramentas oferecidas por aplicativos e dispositivos para monitorar e filtrar o conteúdo acessado.

- Esteja atento a sinais de alerta: Mudanças de comportamento, como perda de sono, isolamento ou queda no desempenho escolar, podem indicar problemas.

Legislação e diretrizes existentes

Diversos países estão avançando em legislações para proteger crianças e adolescentes no ambiente digital. A União Europeia, por exemplo, implementou o Regulamento Geral sobre a Proteção de Dados (GDPR), que inclui regras para garantir que empresas de tecnologia sejam responsáveis pela segurança online de menores. Nos EUA, o Children’s Online Privacy Protection Act (COPPA) estabelece diretrizes claras sobre como os dados de crianças podem ser coletados e utilizados.

No Brasil, a Lei Geral de Proteção de Dados (LGPD) oferece uma base importante para a proteção de dados, inclusive de menores. No entanto, faltam disposições específicas sobre o uso de IA por crianças e adolescentes, o que reforça a necessidade de mais cuidados e uma discussão contínua para que a legislação seja atualizada de forma a abordar as complexidades que essas novas tecnologias trazem.

Conclusão

Embora as empresas de IA devam ser responsabilizadas pela segurança de seus produtos, os pais também desempenham um papel fundamental em garantir que essas tecnologias sejam usadas de forma segura. É essencial monitorar e orientar os jovens quanto ao uso da IA, e os governos precisam continuar avançando com legislações que protejam as gerações mais vulneráveis. Ao unirmos forças – tecnologia, famílias e regulamentações – podemos ajudar a criar um ambiente digital mais seguro e saudável para todos.

Fonte: Lawsuit claims Character.AI is responsible for teen’s suicide